Deep Residual Shrinkage Network ಪಂಡ Deep Residual Network-ನ ಒಂಜಿ improved variant. ಮುಖ್ಯವಾದ್, Deep Residual Shrinkage Network ಉಂಡು Deep Residual Network, attention mechanisms, ಬೊಕ್ಕ soft thresholding functions-ನ್ ಒಟ್ಟು ಸೇರಿಪಾವುಂಡು.

ನಮ Deep Residual Shrinkage Network-ನ working principle-ನ್ ಈ ರೀತಿ ಅರ್ಥ ಮಲ್ಪೊನೊಲಿ. ಸುರುಕು, network unimportant features-ನ್ ಗುರುತಿಸೆರೆ attention mechanisms-ನ್ ಗಲಸುಂಡು. ಬೊಕ್ಕ, network ಈ unimportant features-ನ್ zero ಮಲ್ಪೆರೆ soft thresholding functions-ನ್ ಗಲಸುಂಡು. ಉಲ್ತಾದ್ ಪನ್ಪುನಾಂಡ, network important features-ನ್ ಗುರುತಿಸದ್ ಅವೆನ್ ಮಾತ್ರ ದೀಪುಂಡು. ಈ process deep neural network-ದ ability-ನ್ ಜಾಸ್ತಿ ಮಲ್ಪುಂಡು. Noise ಉಪ್ಪುನ signals-ರ್ದ್ useful features-ನ್ extract ಮಲ್ಪೆರೆ ಉಂದು ಸಹಾಯ ಮಲ್ಪುಂಡು.

1. Research Motivation

ಸುರುಕು, algorithm samples-ನ್ classify ಮಲ್ಪುನಗ, noise ಖಂಡಿತ ಉಪ್ಪುಂಡು. ಈ noise-ಗ್ examples ಪಂಡ Gaussian noise, pink noise, ಮತ್ತು Laplacian noise. ಇನ್ನು ವಿಶಾಲವಾದ್ ಪನ್ಪುನಾಂಡ, samples-ಡ್ current classification task-ಗ್ ಸಂಬಂಧ ಇಜ್ಜಂದಿನ ಮಾಹಿತಿ (irrelevant information) ಉಪ್ಪುನ ಸಾಧ್ಯತೆ ಉಂಡು. ಈ irrelevant information-ನ್ ನಮ noise ಪಂದ್ ಅರ್ಥ ಮಲ್ಪೊನೊಲಿ. ಈ noise classification performance-ನ್ ಕಮ್ಮಿ ಮಲ್ಪು. (Soft thresholding ಉಂದು ಬೆಜಾನ್ signal denoising algorithms-ಡ್ ಒಂಜಿ ಮುಖ್ಯ step ಆದುಂಡು.)

ಒಂಜಿ example ತೂಲೆ, road-ದ ಬರಿಟ್ ಪಾತೆರುನಗ record ಮಲ್ತಿನ audio. ಈ audio-ಡ್ car horns ಬೊಕ್ಕ wheels-ದ ಶಬ್ದ ಉಪ್ಪೊಲಿ. ನಮ ಈ signals-ಗ್ speech recognition ಮಲ್ಪೊಡು ಆಂಡ, background sounds ಖಂಡಿತ results-ಗ್ ತೊಂದರೆ ಮಲ್ಪುಂಡು. Deep learning-ದ ದೃಷ್ಟಿಡ್ ತೂಬುಂಡ, deep neural network ಆ horns ಬೊಕ್ಕ wheels-ಗ್ ಸಂಬಂಧ ಪಟ್ಟ features-ನ್ eliminate ಮಲ್ಪೊಡು. ಈ ರೀತಿ eliminate ಮಲ್ತುಂಡ, ಅವು speech recognition results-ನ್ ಹಾಳ್ ಮಲ್ಪುಜಿ.

ರಡ್ಡೆನೆದ, noise-ದ ಪ್ರಮಾಣ ಪ್ರತಿ sample-ಡ್ಲ ಬೇರೆ ಬೇರೆ ಉಪ್ಪುಂಡು. ಒಂದೇ dataset-ಡ್ಲ ಈ ವ್ಯತ್ಯಾಸ ಬರ್ಪು. (ಉಂದು attention mechanisms-ಗ್ ಸಾರೂಪ್ಯವಾದ್ ಉಂಡು. ಒಂಜಿ image dataset-ನ್ example ಆದ್ ತೂಲೆ. Target object ಇಪ್ಪುನ ಜಾಗ ಪ್ರತಿ image-ಡ್ಲ ಬೇರೆ ಬೇರೆ ಉಪ್ಪೊಲಿ. Attention mechanisms ಪ್ರತಿ image-ಡ್ target object ಇಪ್ಪುನ specific ಜಾಗಗ್ focus ಮಲ್ಪುಂಡು.)

ಉದಾಹರಣೆಗೆ, ಒಂಜಿ cat-and-dog classifier-ನ್ train ಮಲ್ಪುನಗ, 5 “dog” images ಉಂಡು ಪಂದ್ ಎನ್ಕುಲೆ. Image 1-ಡ್ dog ಬೊಕ್ಕ mouse ಉಪ್ಪೊಲಿ. Image 2-ಡ್ dog ಬೊಕ್ಕ goose ಉಪ್ಪೊಲಿ. Image 3-ಡ್ dog ಬೊಕ್ಕ chicken ಉಪ್ಪೊಲಿ. Image 4-ಡ್ dog ಬೊಕ್ಕ donkey ಉಪ್ಪೊಲಿ. Image 5-ಡ್ dog ಬೊಕ್ಕ duck ಉಪ್ಪೊಲಿ. Training time-ಡ್, irrelevant objects classifier-ಗ್ disturb ಮಲ್ಪುಂಡು. ಈ objects ಪಂಡ mice, geese, chickens, donkeys, ಬೊಕ್ಕ ducks. ಈ disturbance-ರ್ದ್ classification accuracy ಕಮ್ಮಿ ಆಪುಂಡು. ನಮ ಈ irrelevant objects-ನ್ ಗುರುತಿಸೆರೆ ಸಾಧ್ಯ ಆಂಡ, ಅವೆಕ್ ಸಂಬಂಧ ಪಟ್ಟ features-ನ್ eliminate ಮಲ್ಪೊಲಿ. ಈ ರೀತಿ ಮಲ್ತುಂಡ, ನಮ cat-and-dog classifier-ನ accuracy-ನ್ improve ಮಲ್ಪೊಲಿ.

2. Soft Thresholding

Soft thresholding ಉಂದು ಬೆಜಾನ್ signal denoising algorithms-ನ core step. Features-ನ absolute values ಒಂಜಿ ನಿರ್ದಿಷ್ಟ threshold-ರ್ದ್ ಕಮ್ಮಿ ಇತ್ತ್ಂಡ, algorithm ಆ features-ನ್ eliminate ಮಲ್ಪುಂಡು. Features-ನ absolute values threshold-ರ್ದ್ ಜಾಸ್ತಿ ಇತ್ತ್ಂಡ, algorithm ಆ features-ನ್ zero-ದ ಕಡೆಕ್ shrink ಮಲ್ಪುಂಡು. Researchers soft thresholding-ನ್ implement ಮಲ್ಪೆರೆ ಈ ಕೆಳಗಿನ formula ಗಲಸುವೆರ್:

\[y = \begin{cases} x - \tau & x > \tau \\ 0 & -\tau \le x \le \tau \\ x + \tau & x < -\tau \end{cases}\]Soft thresholding output-ದ derivative input-ಗ್ ಸಂಬಂಧ ಪಟ್ಟಿಲೆಕ್ಕ ಇಂಚುಂಡು:

\[\frac{\partial y}{\partial x} = \begin{cases} 1 & x > \tau \\ 0 & -\tau \le x \le \tau \\ 1 & x < -\tau \end{cases}\]ಮೇಲ್ದ formula ತೋಜಪಾವಿಲೆಕ್ಕ, soft thresholding-ದ derivative 1 ಅಥವಾ 0 ಆದ್ ಉಪ್ಪುಂಡು. ಈ ಗುಣ ReLU activation function-ದ ಗುಣ-ಲೆಕ್ಕನೆ ಉಂಡು. ಅಂದುಕೋಸ್ಕರ, soft thresholding ಉಂದು deep learning algorithms-ಡ್ gradient vanishing ಬೊಕ್ಕ gradient exploding risk-ನ್ ಕಮ್ಮಿ ಮಲ್ಪುಂಡು.

Soft thresholding function-ಡ್, threshold-ನ್ set ಮಲ್ಪುನಗ ಎರಡು conditions follow ಮಲ್ಪೊಡು. ಒಂಜಿ, threshold positive number ಆದುಪ್ಪೊಡು. ರಡ್ಡ್, threshold input signal-ದ maximum value-ರ್ದ್ ಜಾಸ್ತಿ ಉಪ್ಪೆರೆ ಬಲ್ಲಿ. ಇಲ್ಲಾಂಡ, output ಪೂರಾ zero ಆಪುಂಡು.

ಅತ್ತಂದೆ, threshold ಮೂಜನೆದ condition-ನ್ಲ satisfy ಮಲ್ತುಂಡ ಎಡ್ಡೆ. ಪ್ರತಿ sample-ಗ್, ಆ sample-ದ noise content-ನ ಆಧಾರಡ್, ತನ್ನದೇ ಆಯಿನ independent threshold ಉಪ್ಪೊಡು.

ದಯೆ ಪಂಡ, noise content ಪ್ರತಿ sample-ಡ್ಲ ಯಾವಾಗ್ಲಾ ಬೇರೆ ಬೇರೆ ಉಪ್ಪುಂಡು. ಉದಾಹರಣೆಗೆ, ಒಂದೇ dataset-ಡ್ Sample A-ಡ್ ಕಮ್ಮಿ noise ಉಪ್ಪೊಲಿ, ಆಂಡ Sample B-ಡ್ ಜಾಸ್ತಿ noise ಉಪ್ಪೊಲಿ. ಈ case-ಡ್, soft thresholding ಮಲ್ಪುನಗ Sample A-ಗ್ ಚಿಕ್ಕ threshold ಗಲಸೊಡು. Sample B-ಗ್ ದೊಡ್ಡ threshold ಗಲಸೊಡು. Deep neural networks-ಡ್ ಈ features ಬೊಕ್ಕ thresholds-ಗ್ explicit physical definitions ಇಲ್ಲೆಜಿಂಡಲಾ, ಮೂಲ logic ಮಾತ್ರ ಅಂಚೆನೆ. ಪಂದ್ ಪನ್ಪುನಾಂಡ, ಪ್ರತಿ sample-ಗ್ independent threshold ಉಪ್ಪೊಡು. Specific noise content ಈ threshold-ನ್ ನಿರ್ಧಾರ ಮಲ್ಪುಂಡು.

3. Attention Mechanism

Researchers computer vision field-ಡ್ attention mechanisms-ನ್ ಸುಲಭಡ್ ಅರ್ಥ ಮಲ್ಪೊನೊಲಿ. ಪ್ರಾಣಿಲ visual systems ಪೂರಾ area-ನ್ rapid scan ಮಲ್ಪುನೆ ಮೂಕಾಂತರ targets-ನ್ distinguish ಮಲ್ಪು. ಬೊಕ್ಕ, visual systems target object-ದ ಮಿತ್ತ್ attention focus ಮಲ್ಪುಂಡು. ಈ ಕ್ರಿಯೆ system-ಗ್ ಇನ್ನು ಜಾಸ್ತಿ details extract ಮಲ್ಪೆರೆ ಸಹಾಯ ಮಲ್ಪುಂಡು. ಅದೇ ಸಮಯಡ್, system irrelevant information-ನ್ suppress ಮಲ್ಪುಂಡು. Specifics-ಗ್, attention mechanisms-ನ literature-ನ್ refer ಮಲ್ಪುಲೆ.

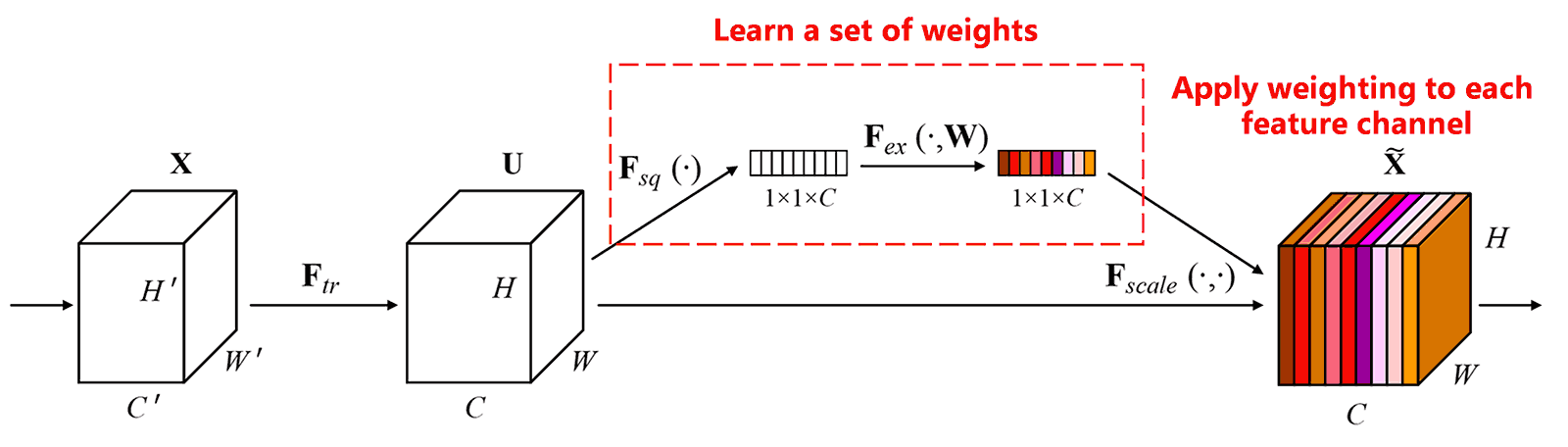

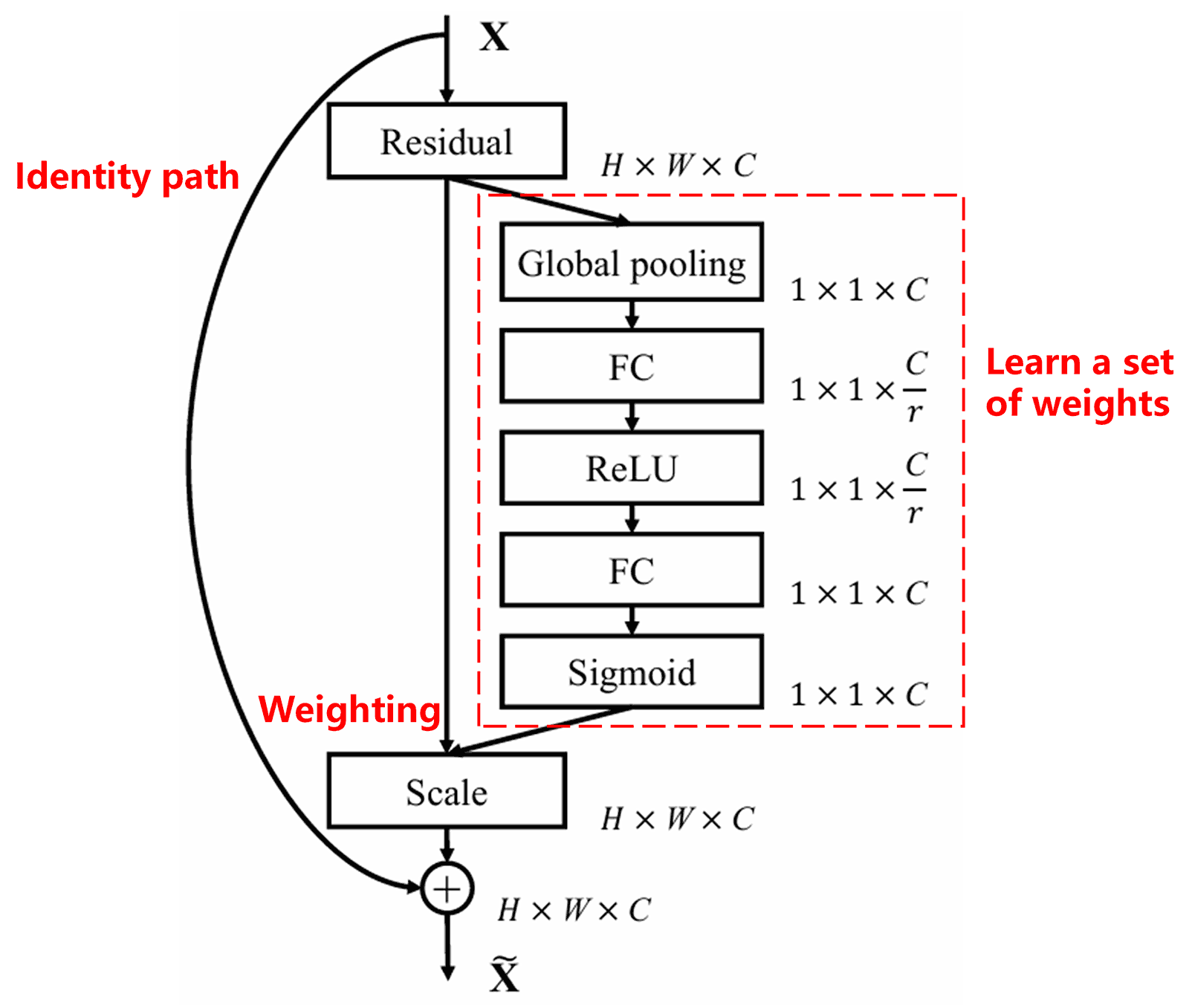

Squeeze-and-Excitation Network (SENet) ಉಂದು attention mechanisms-ನ್ ಗಲಸುವ ಒಂಜಿ ಹೊಸತದ deep learning method. ಬೇರೆ ಬೇರೆ samples-ಡ್, ಬೇರೆ ಬೇರೆ feature channels classification task-ಗ್ ಬೇರೆ ಬೇರೆ ರೀತಿಡ್ contribute ಮಲ್ಪು. SENet weights-ನ ಒಂಜಿ set-ನ್ ಪಡೆಯೆರೆ ಒಂಜಿ ಚಿಕ್ಕ sub-network-ನ್ ಗಲಸುಂಡು. ಬೊಕ್ಕ, SENet ಈ weights-ನ್ ಆ channels-ನ features-ದ ಒಟ್ಟುಗು multiply ಮಲ್ಪುಂಡು. ಈ operation ಪ್ರತಿ channel-ದ features-ನ magnitude-ನ್ adjust ಮಲ್ಪುಂಡು. ನಮ ಈ process-ನ್ ಬೇರೆ ಬೇರೆ feature channels-ಗ್ ಬೇರೆ ಬೇರೆ level-ದ attention apply ಮಲ್ಪುನೆ ಪಂದ್ ಅರ್ಥ ಮಲ್ಪೊನೊಲಿ.

ಈ approach-ಡ್, ಪ್ರತಿ sample-ಗ್ independent weights set ತಿಕ್ಕುಂಡು. ಇನ್ನು clear-ಆದ್ ಪನ್ಪುನಾಂಡ, ಯಾವುದೇ ರಡ್ಡ್ samples-ನ weights ಬೇರೆ ಬೇರೆ ಉಪ್ಪುಂಡು. SENet-ಡ್, weights ಪಡೆಯುನ specific path ಇಂಚುಂಡು: “Global Pooling → Fully Connected Layer → ReLU Function → Fully Connected Layer → Sigmoid Function.”

4. Soft Thresholding with Deep Attention Mechanism

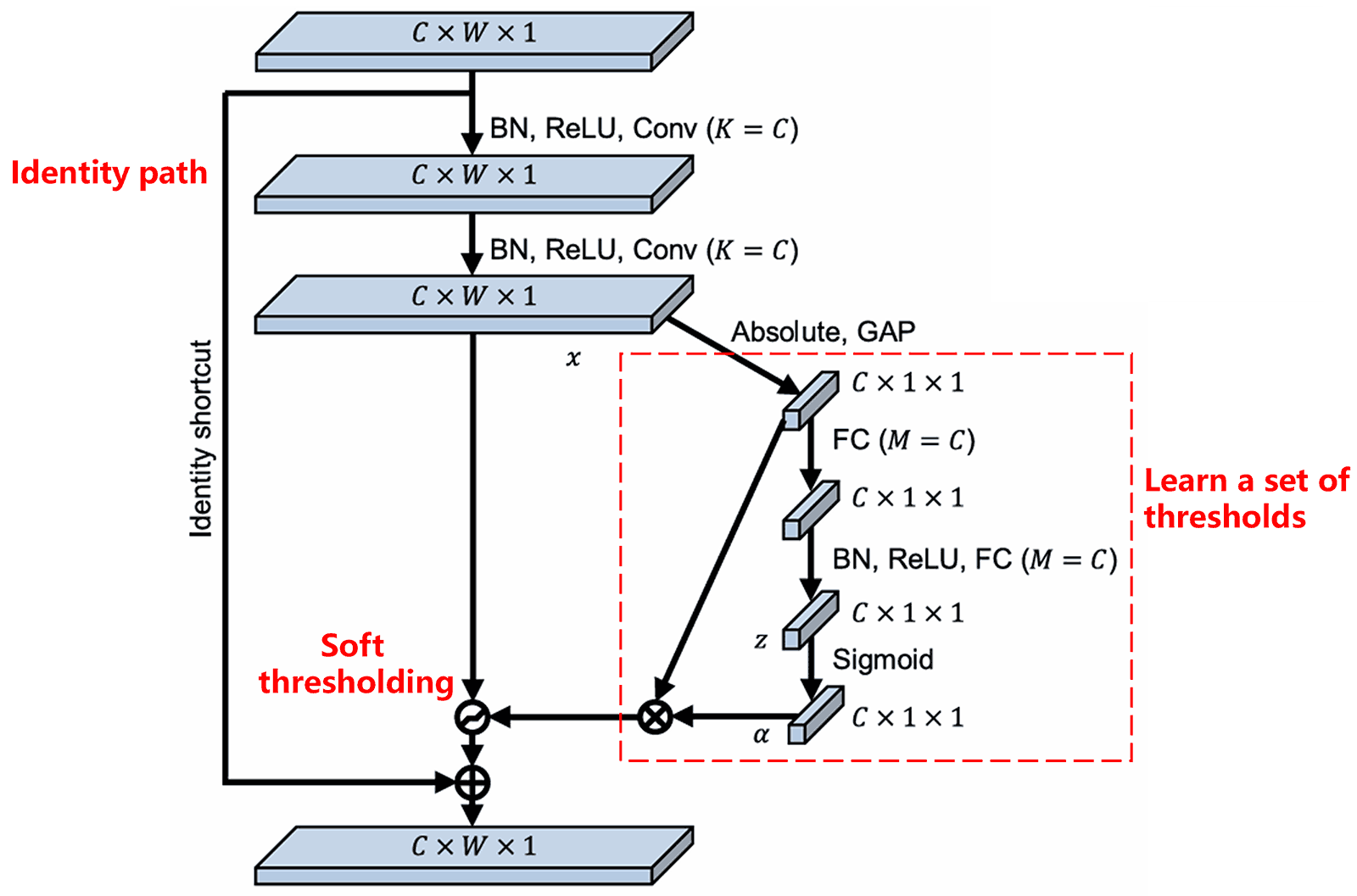

Deep Residual Shrinkage Network ಉಂದು SENet sub-network-ದ structure-ನ್ ಗಲಸುಂಡು. Deep attention mechanism-ದ ಅಡಿಯಡ್ soft thresholding implement ಮಲ್ಪೆರೆ network ಈ structure-ನ್ ಉಪಯೋಗ ಮಲ್ಪುಂಡು. Sub-network (red box-ಡ್ ತೋಜಪಾವಿನ ಭಾಗ) Learn a set of thresholds ಮಲ್ಪುಂಡು. ಬೊಕ್ಕ, network ಈ thresholds-ನ್ ಗಲಸದ್ ಪ್ರತಿ feature channel-ಗ್ soft thresholding apply ಮಲ್ಪುಂಡು.

ಈ sub-network-ಡ್, system ಸುರುಕು input feature map-ದ ಪೂರಾ features-ನ absolute values calculate ಮಲ್ಪುಂಡು. ಬೊಕ್ಕ, system global average pooling ಮತ್ತು averaging ಮಲ್ಪೊಡು A ಪಂದ್ ಗುರುತಿಸುವ feature-ನ್ ಪಡೆಯುಂಡು. ಇನ್ನೊಂದು path-ಡ್, system global average pooling ಆದ್ ಬೊಕ್ಕ feature map-ನ್ ಒಂಜಿ ಚಿಕ್ಕ fully connected network-ಗ್ input ಮಲ್ಪುಂಡು. ಈ fully connected network ಕಡೆದ್ layer-ಡ್ Sigmoid function-ನ್ ಗಲಸುಂಡು. ಈ function output-ನ್ 0 ಮತ್ತು 1 ನಡುಕ್ normalize ಮಲ್ಪುಂಡು. ಈ process-ರ್ದ್ α ಪಂದ್ ಗುರುತಿಸುವ coefficient ತಿಕ್ಕುಂಡು. ನಮ final threshold-ನ್ α × A ಪಂದ್ express ಮಲ್ಪೊಲಿ. ಅಂದುಕೋಸ್ಕರ, threshold ರಡ್ಡ್ numbers-ನ product ಆದುಂಡು. ಒಂಜಿ number 0 ಮತ್ತು 1 ನಡುಕ್ ಉಂಡು. ಇನ್ನೊಂದು number feature map-ದ absolute values-ನ average ಆದುಂಡು. ಈ method threshold positive ಆದ್ ಉಪ್ಪುನೆನ್ ensure ಮಲ್ಪುಂಡು. ಅದೇ ಲೆಕ್ಕ threshold ಮಸ್ತ್ ದೊಡ್ಡ ಆವಂದಿಲೆಕ್ಕಲ ತೂವೊಣುಂಡು.

ಅತ್ತಂದೆ, ಬೇರೆ ಬೇರೆ samples ಬೇರೆ ಬೇರೆ thresholds-ನ್ ಕೊರ್ಪುಂಡು. ಪರಿಣಾಮವಾದ್, ನಮ ಈ method-ನ್ ಒಂಜಿ specialized attention mechanism ಪಂದ್ ಅರ್ಥ ಮಲ್ಪೊನೊಲಿ. ಈ mechanism current task-ಗ್ irrelevant ಆಯಿನ features-ನ್ identify ಮಲ್ಪುಂಡು. Mechanism ಈ features-ನ್ ರಡ್ಡ್ convolutional layers ಮೂಕಾಂತರ 0-ಗ್ ಹತ್ತಿರ ಉಪ್ಪುನ values-ಗ್ transform ಮಲ್ಪುಂಡು. ಬೊಕ್ಕ, mechanism soft thresholding ಗಲಸದ್ ಈ features-ನ್ zero set ಮಲ್ಪುಂಡು. ಅಥವಾ, mechanism current task-ಗ್ relevant ಆಯಿನ features-ನ್ identify ಮಲ್ಪುಂಡು. Mechanism ಈ features-ನ್ ರಡ್ಡ್ convolutional layers ಮೂಕಾಂತರ 0-ರ್ದ್ ದೂರ ಉಪ್ಪುನ values-ಗ್ transform ಮಲ್ಪುಂಡು. ಕಡೆಕ್, mechanism ಈ features-ನ್ preserve ಮಲ್ಪುಂಡು.

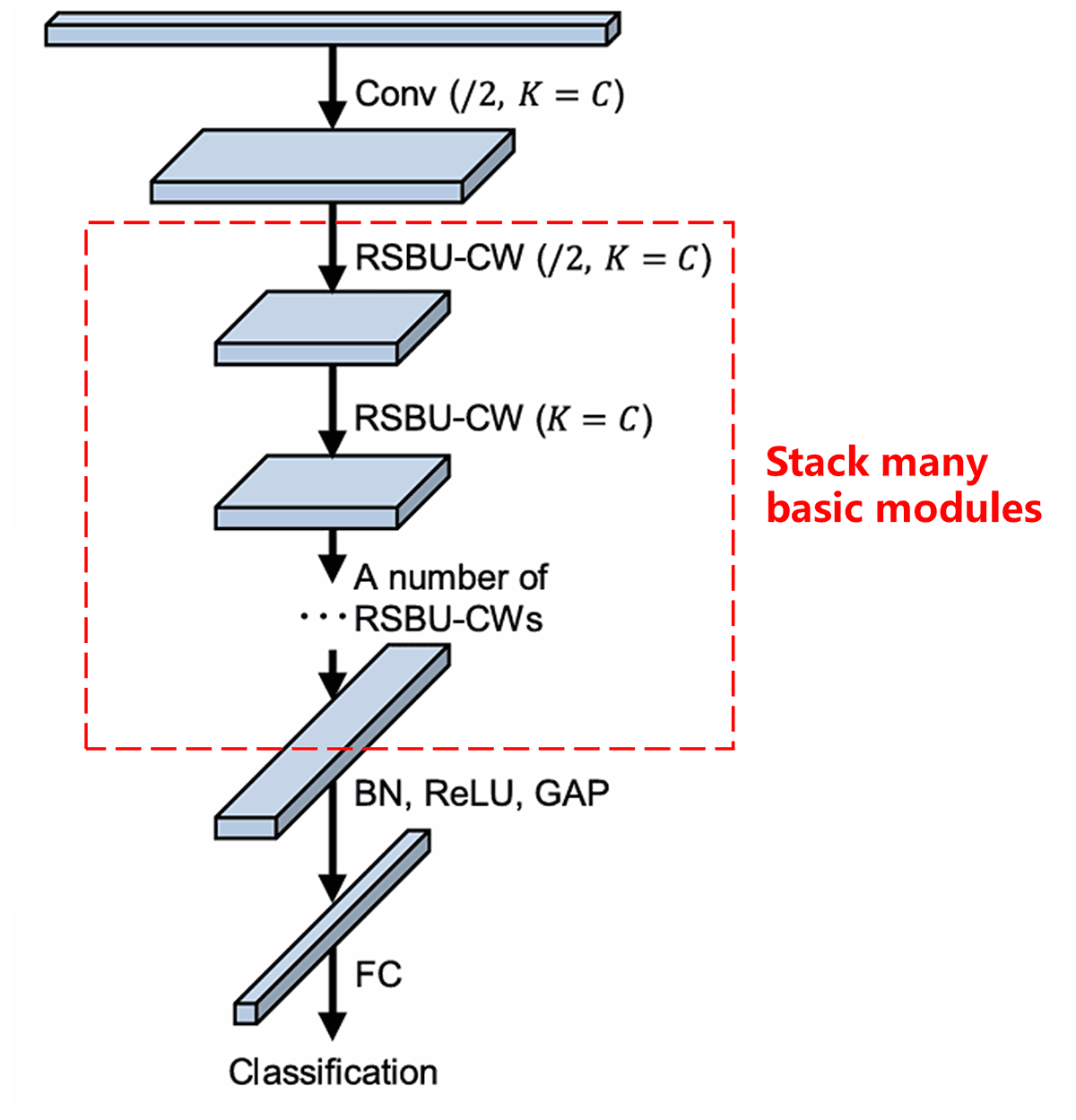

Finally, ನಮ Stack many basic modules ಮಲ್ಪುವ. ನಮ convolutional layers, batch normalization, activation functions, global average pooling, ಬೊಕ್ಕ fully connected output layers-ನ್ಲ ಸೇರಿಪಾವ. ಈ process ಪೂರಾ Deep Residual Shrinkage Network-ನ್ construct ಮಲ್ಪುಂಡು.

5. Generalization Capability

Deep Residual Shrinkage Network ಉಂದು feature learning-ಗ್ ಒಂಜಿ general method. ದಯೆ ಪಂಡ, ಬೆಜಾನ್ feature learning tasks-ಡ್ samples-ಡ್ noise ಉಪ್ಪುಂಡು. Samples-ಡ್ irrelevant information-ಲ ಉಪ್ಪುಂಡು. ಈ noise ಮತ್ತು irrelevant information feature learning-ನ performance-ನ್ affect ಮಲ್ಪೊಲಿ. ಉದಾಹರಣೆಗೆ:

Image classification-ನ್ ತೂಲೆ. ಒಂಜಿ image-ಡ್ ಅದೇ ಸಮಯಡ್ ಬೆಜಾನ್ ಬೇರೆ objects ಉಪ್ಪೊಲಿ. ನಮ ಈ objects-ನ್ “noise” ಪಂದ್ ಅರ್ಥ ಮಲ್ಪೊನೊಲಿ. Deep Residual Shrinkage Network ಬಹುಶಃ attention mechanism-ನ್ ಉಪಯೋಗ ಮಲ್ಪೊಲಿ. Network ಈ “noise”-ನ್ ಗಮನಿಸುಂಡು. ಬೊಕ್ಕ, network soft thresholding ಗಲಸದ್ ಈ “noise”-ಗ್ ಸಂಬಂಧ ಪಟ್ಟ features-ನ್ zero set ಮಲ್ಪುಂಡು. ಈ ಕ್ರಿಯೆ image classification accuracy-ನ್ improve ಮಲ್ಪೆರೆ ಸಹಾಯಕ ಆವೊಲಿ.

Speech recognition-ನ್ ತೂಲೆ. ಮುಖ್ಯವಾದ್, road-ದ ಬರಿಟ್ ಅಥವಾ factory workshop-ದ ಉಳಯಿ ಪಾತೆರುನಗ ಉಪ್ಪುನ noisy environments-ನ್ ತೂಲೆ. Deep Residual Shrinkage Network speech recognition accuracy-ನ್ improve ಮಲ್ಪೊಲಿ. ಅಥವಾ ಕಮ್ಮಿ ಆಂಡಲ, network ಒಂಜಿ methodology-ನ್ offer ಮಲ್ಪುಂಡು. ಈ methodology speech recognition accuracy-ನ್ improve ಮಲ್ಪೆರೆ ಸಮರ್ಥ ಆದುಂಡು.

Reference

Minghang Zhao, Shisheng Zhong, Xuyun Fu, Baoping Tang, Michael Pecht, Deep residual shrinkage networks for fault diagnosis, IEEE Transactions on Industrial Informatics, 2020, 16(7): 4681-4690.

https://ieeexplore.ieee.org/document/8850096

BibTeX

@article{Zhao2020,

author = {Minghang Zhao and Shisheng Zhong and Xuyun Fu and Baoping Tang and Michael Pecht},

title = {Deep Residual Shrinkage Networks for Fault Diagnosis},

journal = {IEEE Transactions on Industrial Informatics},

year = {2020},

volume = {16},

number = {7},

pages = {4681-4690},

doi = {10.1109/TII.2019.2943898}

}

Academic Impact

ಈ paper Google Scholar-ಡ್ 1400-ಕ್ಕ್ ಜಾಸ್ತಿ citations ಪಡೆತ್ಂಡ್.

Incomplete statistics-ನ ಪ್ರಕಾರ, researchers Deep Residual Shrinkage Network (DRSN)-ನ್ 1000-ಕ್ಕ್ ಜಾಸ್ತಿ publications/studies-ಡ್ apply ಮಲ್ತ್ದೆರ್. ಈ applications ವಿಶಾಲ ಕ್ಷೇತ್ರಲೆನ್ cover ಮಲ್ಪುಂಡು. ಈ ಕ್ಷೇತ್ರಲು ಪಂಡ mechanical engineering, electrical power, vision, healthcare, speech, text, radar, ಬೊಕ್ಕ remote sensing.