Deep Residual Shrinkage Network нь Deep Residual Network-ийн сайжруулсан хувилбар юм. Үндсэндээ энэ нь Deep Residual Network, Attention mechanism болон Soft thresholding функцуудын нэгдэл юм.

Тодорхой хэмжээгээр, Deep Residual Shrinkage Network-ийн ажиллах зарчмыг дараах байдлаар ойлгож болно: энэ нь Attention mechanism-ийг ашиглан чухал бус feature-үүдийг илрүүлж, Soft thresholding функцээр тэдгээрийг тэг (zero) болгодог; эсрэгээрээ чухал feature-үүдийг илрүүлж, тэдгээрийг хадгалж үлддэг. Энэ процесс нь шуугиан (noise) агуулсан дохионоос хэрэгтэй feature-үүдийг ялгаж авах deep neural network-ийн чадварыг сайжруулдаг.

1. Судалгааны сэдэл (Research Motivation)

Нэгдүгээрт, sample-үүдийг ангилах үед Gaussian noise, pink noise болон Laplacian noise зэрэг шуугиан (noise) байх нь зайлшгүй юм. Илүү өргөн утгаар нь авч үзвэл, sample-үүд нь тухайн ангиллын даалгаварт (classification task) хамааралгүй мэдээллийг агуулдаг бөгөөд үүнийг мөн шуугиан гэж ойлгож болно. Эдгээр шуугиан нь ангиллын үр дүнд сөргөөр нөлөөлж болзошгүй. (Soft thresholding нь олон төрлийн сигнал цэвэрлэх буюу signal denoising алгоритмуудын гол алхам юм.)

Жишээлбэл, замын хажууд ярилцах үед ярианд машины дуут дохио, дугуйны чимээ холилдож болно. Эдгээр дохионд speech recognition хийх үед үр дүн нь арын дэвсгэр чимээнээс шалтгаалан зайлшгүй нөлөөлнө. Deep learning-ийн өнцгөөс харвал, дуут дохио болон дугуйны чимээнд харгалзах feature-үүдийг deep neural network дотор устгах шаардлагатай бөгөөд ингэснээр speech recognition-ий үр дүнд нөлөөлөхөөс сэргийлнэ.

Хоёрдугаарт, нэг dataset дотор ч гэсэн шуугианы хэмжээ нь sample бүрт өөр өөр байдаг. (Энэ нь Attention mechanism-тай төстэй талтай; жишээлбэл image dataset дээр зорилтот обьектын байршил зураг бүрт өөр байж болох ба Attention mechanism нь тухайн зураг бүрийн зорилтот байршилд анхаарлаа төвлөрүүлж чаддаг.)

Жишээлбэл, муур нохойны classifier сургах үед “нохой” гэсэн label-тэй таван зураг байлаа гэж бодъё. Эхний зурагт нохой ба хулгана, хоёр дахь зурагт нохой ба галуу, гурав дахь зурагт нохой ба тахиа, дөрөв дэх зурагт нохой ба илжиг, тав дахь зурагт нохой ба нугас байж болно. Сургалтын явцад classifier нь хулгана, галуу, тахиа, илжиг, нугас зэрэг хамааралгүй обьектуудын нөлөөлөлд өртөж, улмаар ангиллын нарийвчлал (accuracy) буурахад хүрнэ. Хэрэв бид эдгээр хамааралгүй обьектүүдийг—хулгана, галуу, тахиа, илжиг, нугас—илрүүлж, тэдгээрт харгалзах feature-үүдийг устгаж чадвал муур нохойны classifier-ийн нарийвчлалыг сайжруулах боломжтой.

2. Soft Thresholding

Soft thresholding нь олон төрлийн signal denoising алгоритмуудын гол алхам юм. Энэ нь абсолют утга нь тодорхой босго (threshold)-оос бага feature-үүдийг устгаж, босгоос их feature-үүдийг тэг рүү агшаадаг (shrinks towards zero). Үүнийг дараах томьёогоор хэрэгжүүлж болно:

\[y = \begin{cases} x - \tau & x > \tau \\ 0 & -\tau \le x \le \tau \\ x + \tau & x < -\tau \end{cases}\]Soft thresholding-ийн гаралтын оролтоос хамаарсан уламжлал нь:

\[\frac{\partial y}{\partial x} = \begin{cases} 1 & x > \tau \\ 0 & -\tau \le x \le \tau \\ 1 & x < -\tau \end{cases}\]Дээр харуулсанчлан, Soft thresholding-ийн уламжлал нь 1 эсвэл 0 байна. Энэ шинж чанар нь ReLU activation функцтэй ижил юм. Тиймээс Soft thresholding нь deep learning алгоритмуудад gradient vanishing болон gradient exploding үүсэх эрсдэлийг бууруулж чаддаг.

Soft thresholding функцэд босго (threshold)-ыг тохируулахдаа хоёр нөхцөлийг хангасан байх ёстой: нэгдүгээрт, босго нь эерэг тоо байх ёстой; хоёрдугаарт, босго нь оролтын сигналын хамгийн их утгаас хэтрэхгүй байх ёстой, эс бөгөөс гаралт нь бүхэлдээ тэг болно.

Түүнчлэн, босго нь гурав дахь нөхцөлийг хангаж байх нь зүйтэй: sample бүр өөрийн шуугианы агууламж дээр үндэслэсэн бие даасан босготой байх ёстой.

Учир нь шуугианы агууламж нь sample-үүдийн хооронд ихэвчлэн өөр өөр байдаг. Жишээлбэл, нэг dataset дотор Sample A нь бага шуугиантай, харин Sample B нь их шуугиантай байх тохиолдол түгээмэл байдаг. Энэ тохиолдолд denoising алгоритм дотор Soft thresholding хийхдээ Sample A нь бага босго (threshold) ашиглах ёстой бол Sample B нь их босго ашиглах ёстой. Хэдийгээр deep neural network дотор эдгээр feature болон threshold-ууд нь тодорхой физик утгаа алддаг ч, цаад үндсэн логик нь ижил хэвээр байна. Өөрөөр хэлбэл, sample бүр өөрийн шуугианы агууламжаас хамаарсан бие даасан босготой (independent threshold) байх ёстой.

3. Attention Mechanism

Attention mechanism нь Computer Vision-ийн салбарт ойлгоход харьцангуй хялбар байдаг. Амьтны харааны систем нь бүх талбайг хурдан сканнердаж, зорилтот обьектыг ялгаж, улмаар анхаарлаа (attention) тухайн обьект дээр төвлөрүүлж илүү их нарийн ширийн зүйлийг олж харахын зэрэгцээ хамааралгүй мэдээллийг дардаг. Дэлгэрэнгүйг Attention mechanism-ийн талаарх материалуудаас харна уу.

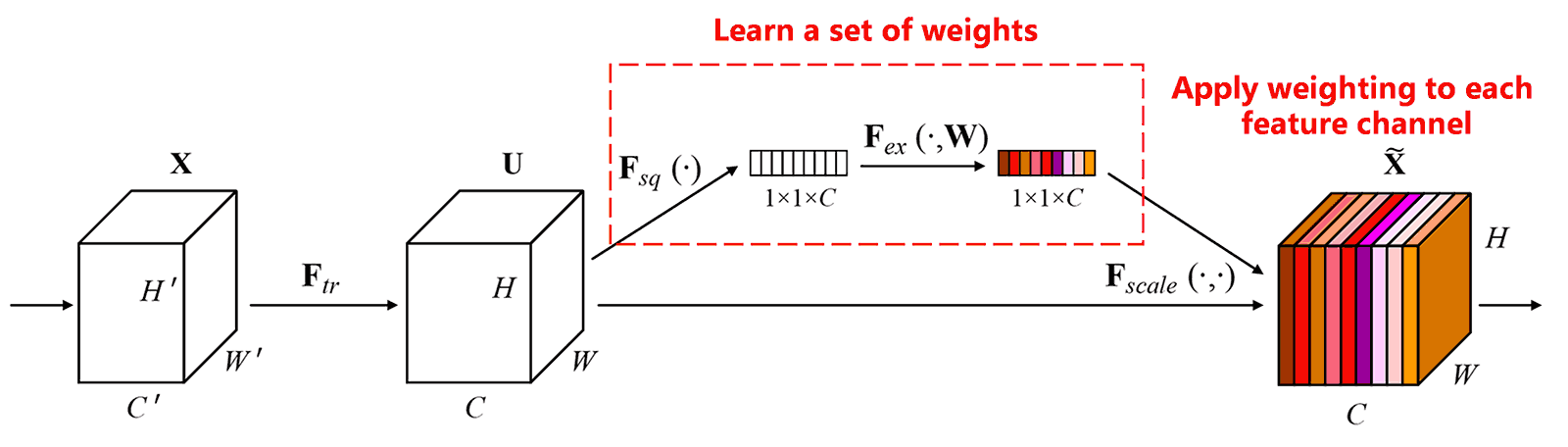

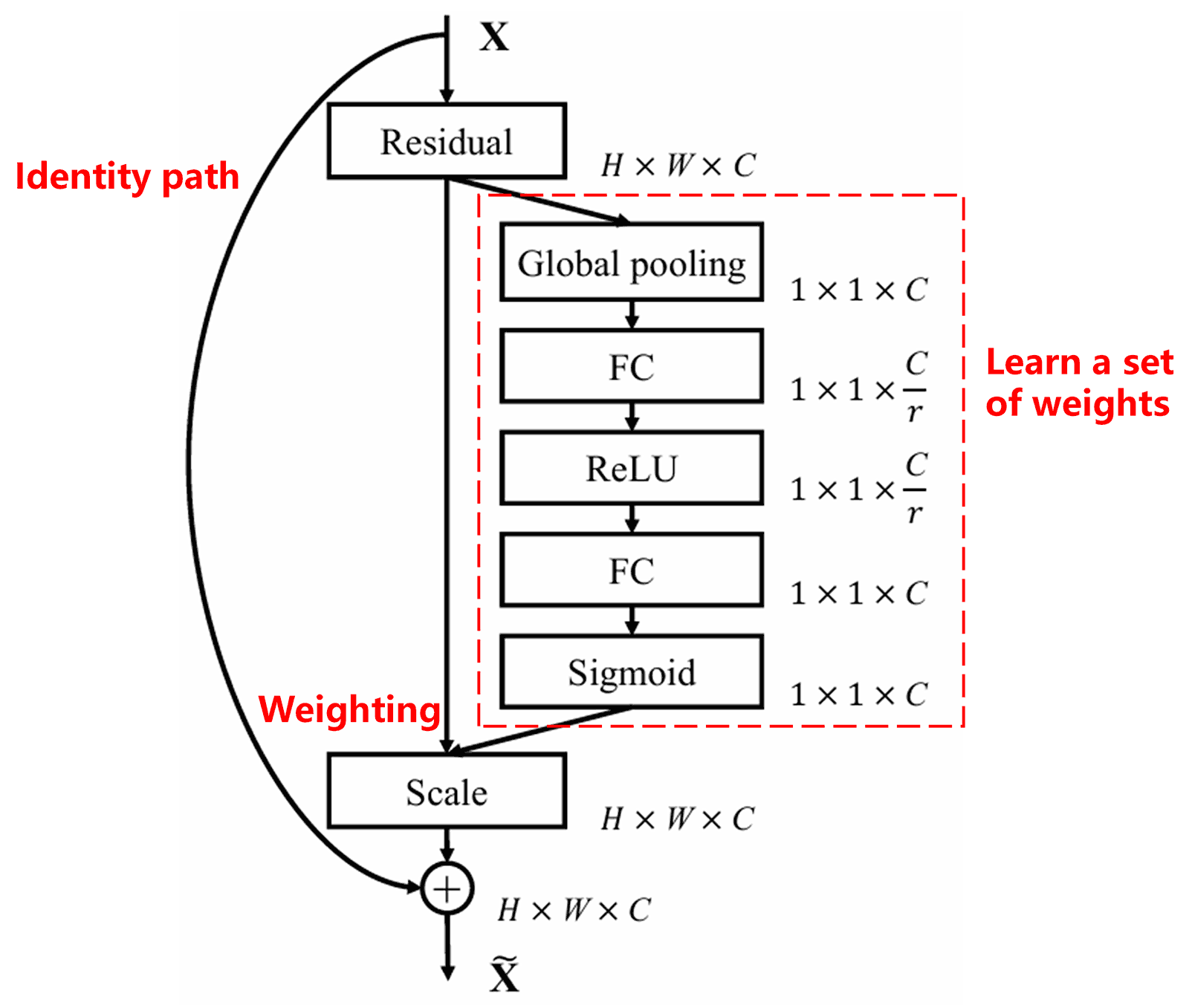

Squeeze-and-Excitation Network (SENet) нь Attention mechanism ашигладаг харьцангуй шинэ deep learning арга юм. Янз бүрийн sample-үүдийн хувьд, ангиллын даалгаварт оруулах feature channel-уудын хувь нэмэр нь ихэвчлэн өөр өөр байдаг. SENet нь жингийн багц (Learn a set of weights)-ыг гаргаж авахын тулд жижиг sub-network ашигладаг бөгөөд дараа нь эдгээр жинг харгалзах сувгуудын feature-үүдээр үржүүлж, суваг бүрийн feature-ийн хэмжээг тохируулдаг. Энэ процессыг feature channel бүрт өөр өөр түвшний Attention (Weighting) өгч байна гэж үзж болно (Apply weighting to each feature channel).

Энэ аргаар sample бүр өөрийн бие даасан жингийн багцтай болдог. Өөрөөр хэлбэл, дурын хоёр sample-ийн жин (weights) нь өөр байна. SENet-д жинг гаргаж авах тусгай зам нь “Global Pooling → Fully Connected Layer → ReLU Function → Fully Connected Layer → Sigmoid Function” юм.

4. Deep Attention Mechanism бүхий Soft Thresholding

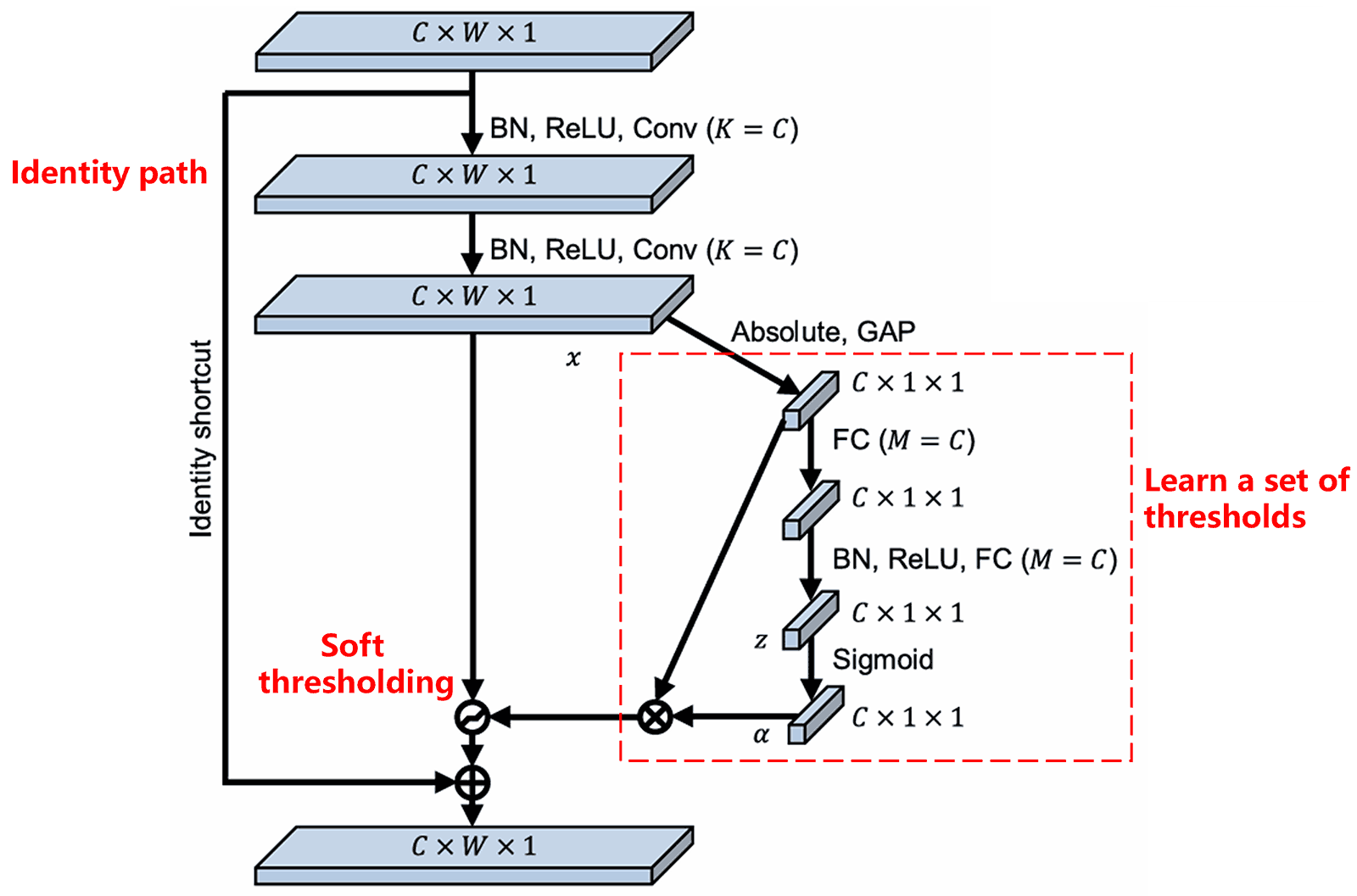

Deep Residual Shrinkage Network нь дээр дурдсан SENet-ийн sub-network бүтцээс санаа авч, Deep Attention mechanism-ийн дор Soft thresholding-ийг хэрэгжүүлдэг. Sub-network (улаан хайрцагт байгаа)-оор дамжуулан feature channel бүрт Soft thresholding хийх босго (thresholds)-ын багцыг сурч авдаг (Learn a set of thresholds).

Энэ sub-network дотор, эхлээд оролтын feature map-ийн бүх feature-үүдийн абсолют утгыг тооцоолно. Дараа нь Global Average Pooling (GAP) болон дундажлах үйлдлээр A гэж тэмдэглэгдэх feature-ийг гаргаж авна. Нөгөө замд, Global Average Pooling хийсний дараах feature map нь жижиг Fully Connected (FC) network-д ордог. Энэхүү FC network нь Sigmoid функцийг сүүлийн давхарга болгон ашиглаж, гаралтыг 0 ба 1-ийн хооронд normalize хийж, α гэж тэмдэглэгдэх коэффициентийг гаргадаг. Эцсийн босгыг α × A гэж илэрхийлж болно. Тиймээс босго нь 0 ба 1-ийн хоорондох тоо болон feature map-ийн абсолют утгуудын дунджийн үржвэр юм. Энэ арга нь босгыг зөвхөн эерэг байлгахаас гадна хэт том биш байхыг баталгаажуулдаг.

Түүнчлэн, өөр өөр sample-үүд нь өөр өөр босготой (thresholds) байдаг. Тиймээс тодорхой хэмжээгээр үүнийг тусгай Attention mechanism гэж ойлгож болно: энэ нь одоогийн даалгаварт хамааралгүй feature-үүдийг илрүүлж, хоёр convolutional layer-ээр дамжуулан тэдгээрийг тэгтэй ойролцоо утгатай болгож, Soft thresholding ашиглан тэдгээрийг тэг болгодог; эсвэл одоогийн даалгаварт хамааралтай feature-үүдийг илрүүлж, хоёр convolutional layer-ээр дамжуулан тэдгээрийг тэгээс хол утгатай болгож, тэдгээрийг хадгалж үлддэг.

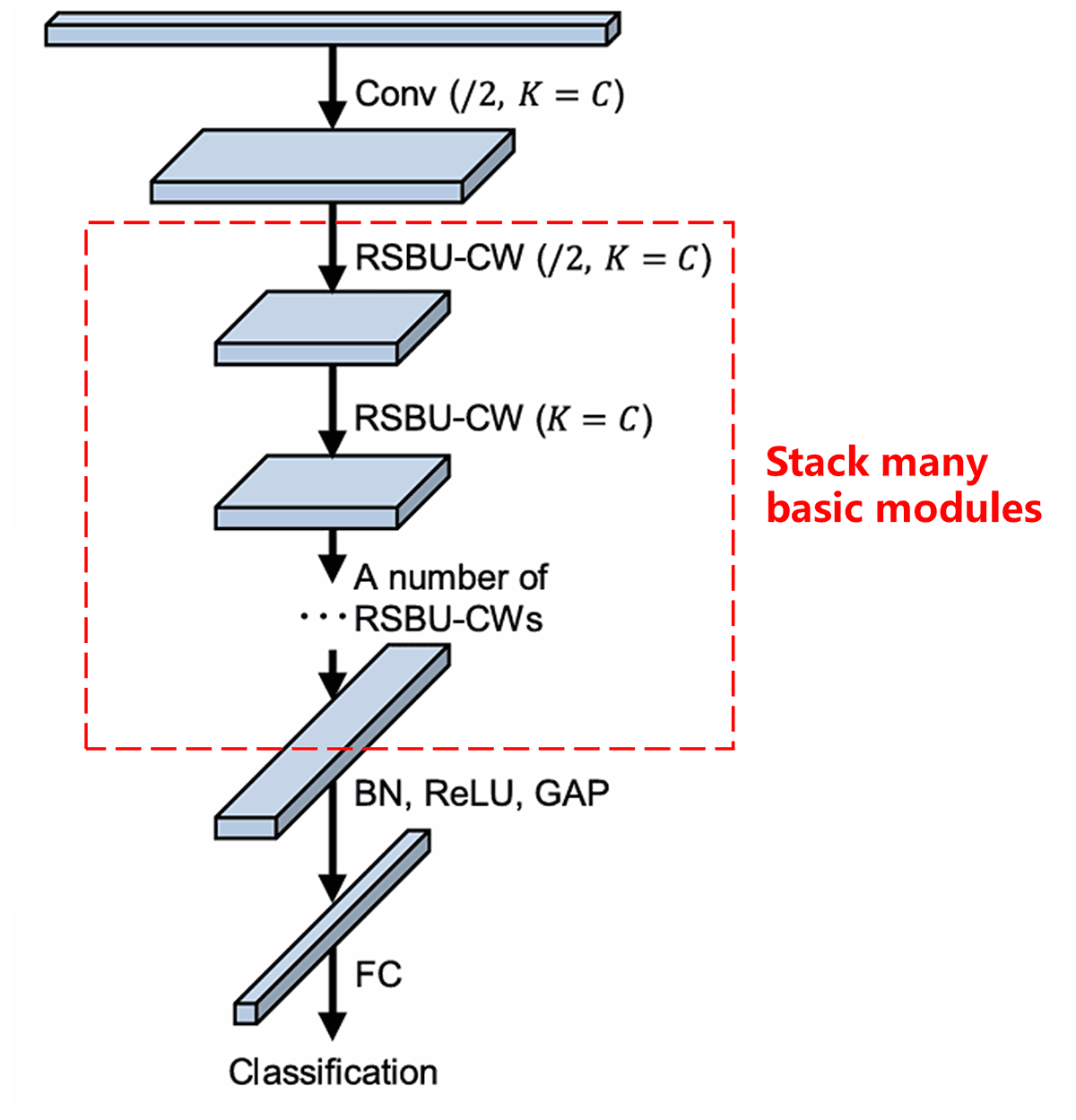

Эцэст нь, тодорхой тооны basic module-уудыг (Stack many basic modules) convolutional layer, batch normalization, activation function, global average pooling болон fully connected output layer-үүдийн хамт давхарлан байрлуулснаар бүрэн Deep Residual Shrinkage Network-ийг бүтээнэ. Мөн үндсэн бүтцэд Identity path ашиглагддаг.

5. Ерөнхий чадвар (Generalization Capability)

Deep Residual Shrinkage Network нь үнэндээ feature learning-ийн ерөнхий арга юм. Учир нь олон feature learning даалгавруудад sample-үүд нь их бага хэмжээгээр шуугиан болон хамааралгүй мэдээллийг агуулж байдаг. Эдгээр шуугиан болон хамааралгүй мэдээлэл нь feature learning-ийн гүйцэтгэлд нөлөөлж болзошгүй. Жишээлбэл:

Image classification (зураг ангилал) дээр, хэрэв зурагт олон төрлийн бусад обьект нэгэн зэрэг орсон байвал эдгээр обьектыг “шуугиан” гэж ойлгож болно. Deep Residual Shrinkage Network нь Attention mechanism-ийг ашиглан энэхүү “шуугиан”-ыг анзаарч, улмаар Soft thresholding ашиглан уг “шуугиан”-д харгалзах feature-үүдийг тэг болгосноор image classification-ий нарийвчлалыг сайжруулах боломжтой.

Speech recognition (яриа таних) дээр, ялангуяа замын хажууд эсвэл үйлдвэрийн цех дотор ярилцах зэрэг харьцангуй их шуугиантай орчинд Deep Residual Shrinkage Network нь speech recognition-ий нарийвчлалыг сайжруулах, эсвэл ядаж нарийвчлалыг сайжруулах арга зүйг санал болгож чадна.

Reference

Minghang Zhao, Shisheng Zhong, Xuyun Fu, Baoping Tang, Michael Pecht, Deep residual shrinkage networks for fault diagnosis, IEEE Transactions on Industrial Informatics, 2020, 16(7): 4681-4690.

https://ieeexplore.ieee.org/document/8850096

BibTeX

@article{Zhao2020,

author = {Minghang Zhao and Shisheng Zhong and Xuyun Fu and Baoping Tang and Michael Pecht},

title = {Deep Residual Shrinkage Networks for Fault Diagnosis},

journal = {IEEE Transactions on Industrial Informatics},

year = {2020},

volume = {16},

number = {7},

pages = {4681-4690},

doi = {10.1109/TII.2019.2943898}

}

Academic Impact

Энэхүү өгүүлэл нь Google Scholar дээр 1400 гаруй ишлэл (citation) авсан байна.

Дутуу статистик мэдээллээр, Deep Residual Shrinkage Network (DRSN)-ийг механик инженерчлэл, цахилгаан эрчим хүч, vision, эрүүл мэнд, яриа, текст, радарын болон зайнаас тандан судлах (remote sensing) зэрэг олон салбарын 1000 гаруй бүтээл/судалгаанд шууд ашигласан эсвэл өөрчилж ашигласан байна.